میزان توانایی کارمندان عربستانی در تشخیص دیپفیک از تصویر واقعی

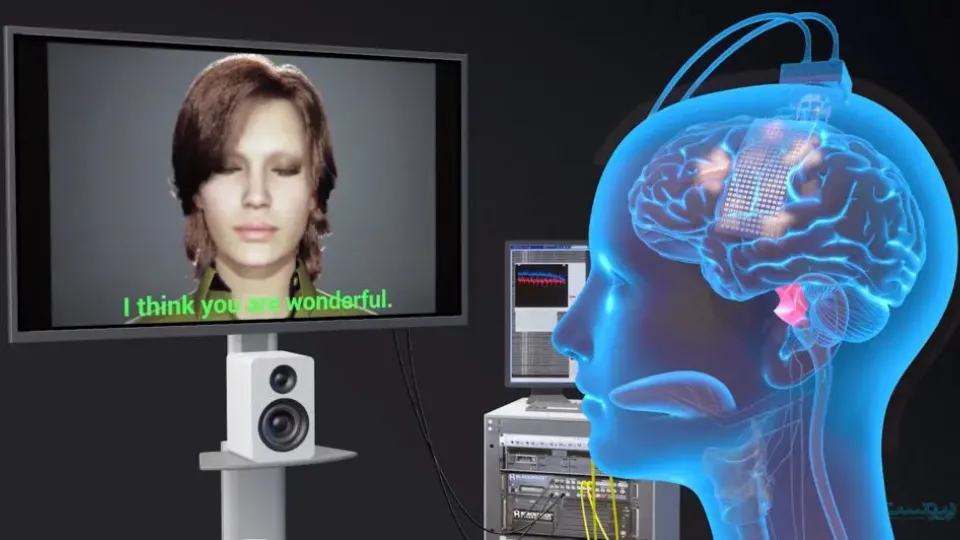

به گزارش کارگروه بینالملل سایبربان؛ براساس نظرسنجی دیجیتالیسازی کسب و کار از شرکت امنیت سایبری کسپرسکی (Kaspersky)، حدود 41 درصد از کارمندان در عربستان سعودی گفتند که میتوانند دیپفیک را از یک تصویر واقعی تشخیص دهند. علیرغم این ادعا، در آزمایش انجام شده مشخص شد که تنها 20 درصد میتوانند این کار را که توسط هوش مصنوعی تولید شده انجام دهند.

این بدان معنا است که سازمانها در برابر چنین کلاهبرداریهایی آسیبپذیر هستند، زیرا مجرمان سایبری از تصاویر مولد هوش مصنوعی به روشهای مختلف برای فعالیتهای غیرقانونی استفاده میکنند. آنها میتوانند از دیپفیک برای ایجاد ویدیوها یا تصاویر جعلی استفاده کنند که میتواند برای کلاهبرداری از افراد یا سازمانها استفاده شود.

به عنوان مثال، مجرمان سایبری میتوانند ویدیوی جعلی از مدیر عاملی که درخواست انتقال پول یا مجوز پرداخت را دارد، ایجاد کنند که میتواند برای سرقت وجوه شرکت مورد استفاده قرار گیرد. میتوان ویدئوها یا تصاویر مخربی از افراد ایجاد و از آنها برای اخاذی پول یا سرقت اطلاعات استفاده کرد. مجرمان سایبری همچنین میتوانند از دیپفیک برای انتشار اطلاعات نادرست یا دستکاری افکار عمومی استفاده کنند. 46 درصد از کارمندان در عربستان سعودی معتقدند که شرکت آنها ممکن است به دلیل دیپفیک ضرر کند.

دیمیتری آنیکین (Dmitry Anikin )، محقق ارشد داده در کسپرسکی، گفت :

«اگرچه بسیاری از کارمندان ادعا کردند که میتوانند یک دیپفیک را تشخیص دهند، اما تحقیقات کسپرسکی نشان داد که فقط نیمی از آنها واقعاً توانایی انجام این کار را دارند. بسیار رایج است که کاربران مهارتهای دیجیتال خود را بیش از حد ارزیابی میکنند. برای سازمانها، این به معنای آسیبپذیری در فایروال انسانی و خطرات احتمالی سایبری و برای زیرساختها، به معنای آسیبپذیری در منابع مالی و محصولات است. نظارت مستمر بر منابع دارک وب، بینشهای ارزشمندی را در مورد صنعت دیپفیک ارائه میکند و به محققان این امکان را میدهد تا آخرین روندها و فعالیتهای عوامل تهدید را در این فضا دنبال کنند. این نظارت یک جزء حیاتی از تحقیقات دیپفیک است که به بهبود درک ما از چشمانداز تهدید در حال تکامل کمک میکند. سرویس هوشمند ردپای دیجیتال کسپرسکی شامل چنین نظارتی است تا به مشتریانش کمک کند در مورد تهدیدات مرتبط با دیپفیک جلوتر باشند.»

برای محافظت در برابر تهدیدات مربوط به دیپفیک، کسپرسکی توصیه میکند :

• شیوههای امنیت سایبری موجود در سازمان خود را نه تنها در قالب نرمافزار، بلکه در قالب مهارتهای توسعه یافته فناوری اطلاعات بررسی و از اطلاعات تهدید کسپرسکی برای پیشی گرفتن از چشمانداز تهدید فعلی استفاده کنید.

• تقویت فایروال انسانی شرکت : اطمینان حاصل کنید که کارمندان متوجه میشوند که دیپفیک چیست، چگونه کار میکند و چه چالشهایی پیش رو دارند. آگاهی و انگیزههای آموزشی مستمری برای آموزش به کارمندان داشته باشید که چگونه یک دیپفیک را تشخیص دهند. پلتفرم آگاهی امنیتی خودکار کسپرسکی به کارمندان کمک میکند تا در برابر جدیدترین تهدیدات بهروز بمانند و سطح سواد دیجیتالی را افزایش میدهد.

• از منابع خبری با کیفیت خوب استفاده کنید. بیسوادی اطلاعاتی همچنان عاملی حیاتی برای تکثیر دیپفیک است.

• پروتکلهای خوبی مانند «اعتماد کنید، اما تأیید کنید» داشته باشید. نگرش شکآمیز به پست صوتی و ویدیوها تضمین نمیکند که مردم هرگز فریب نخواهند خورد، اما میتواند به جلوگیری از بسیاری از رایجترین تلهها کمک کند.

• ویژگیهای کلیدی ویدیوهای دیپفیک که باید به آنها توجه داشته باشید تا قربانی نشوید، عبارتند از : حرکت تند، تغییر نور از یک فریم به فریم دیگر، تغییر رنگ پوست، پلک زدن عجیب یا اصلاً پلک زدن، لبهایی که با صدا هماهنگ نیستند، مصنوعات دیجیتالی روی تصویر، کیفیت پایین کدگذاری شده ویدیو به طور عمدی و نور ضعیف.